Dopo tante discussioni e diversi drammi causati da sfide pericolose; TikTok sta cercando di rafforzare la tutela dei minori sulla sua piattaforma. Il social network ha parlato del sistema Content Levels, che impedisce agli utenti giovani di accedere ai contenuti per adulti.

Come forse saprai, TikTok ha cercato di ricostruire la propria immagine negli ultimi mesi. La colpa è di diverse sfide pericolose, che per alcuni hanno portato a tragedie. Le ultime sono due bambine di 8 e 9 anni che hanno perso la vita cercando di ricreare la sfida il 6 luglio 2022.

Poco dopo questa tragedia, un autorevole insider ha pubblicato informazioni secondo cui su TikTok era in fase di test un nuovo sistema. Questa era una funzione per limitare l'accesso dei minori ai contenuti per adulti.

Per rendere l'app più sicura, TikTok introdurrà filtri di contenuto e classificazioni per maturità

Tuttavia, questo mercoledì 13 luglio 2022, l’app ha finalmente fornito i dettagli di questo sistema in un post ufficiale sul blog. Lo scopo di questa funzionalità, chiamata Livelli di contenuto, è offrire diversi livelli di contenuto su misura per l'età del pubblico.

“Mentre continuiamo a costruire e migliorare questi sistemi, siamo entusiasti di contribuire alle sfide a lungo termine del settore nella creazione di sistemi di raccomandazione per un pubblico diversificato. Riconosciamo anche che ciò che stiamo cercando di ottenere è difficile e che potremmo commettere degli errori", riferisce il social network.

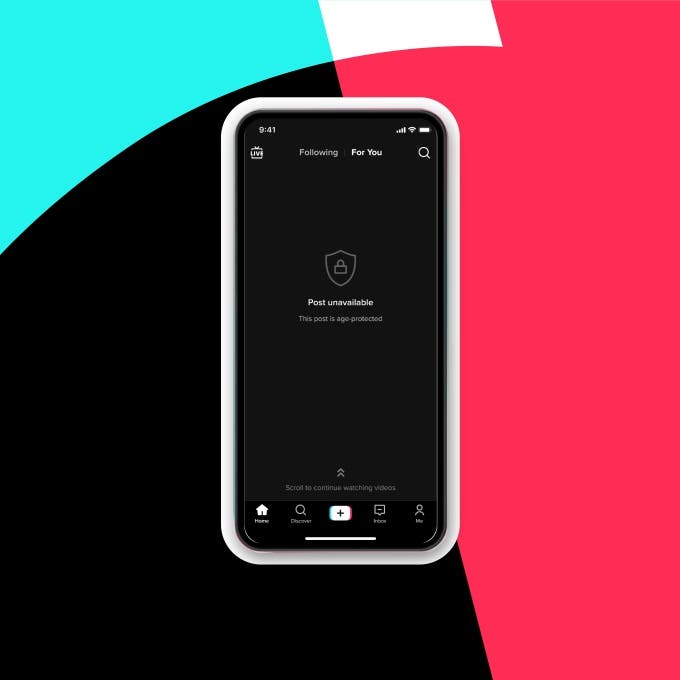

Nelle prossime settimane, quindi, l'app introdurrà la prima versione dei Livelli di contenuto per evitare che contenuti con temi per adulti raggiungano gli utenti minori di 18 anni. Infatti, quando un video ha una tematica adulta o è destinato a un pubblico adulto, gli verrà assegnata una classificazione "matura" (possiamo paragonarla al sistema PEGI utilizzato, ad esempio, nei videogiochi).